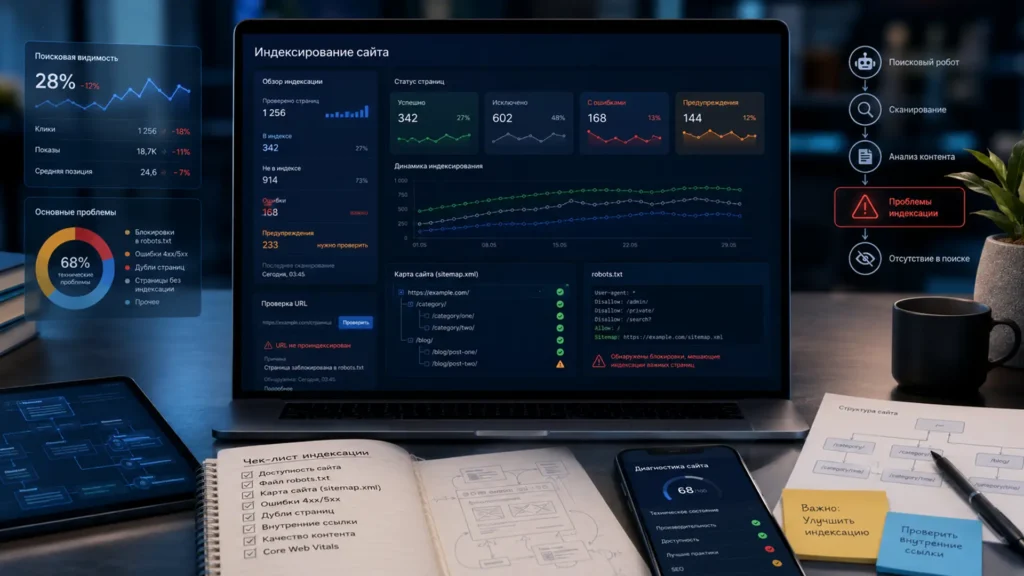

Сайт может не индексироваться из-за запрета в robots.txt, тега noindex, ошибок sitemap, неправильного canonical, дублей страниц, ошибок 404, 403 или 500, слабой внутренней перелинковки, технических проблем или низкой ценности страницы. Важно помнить: robots.txt управляет обходом URL, но сам по себе не является надёжным способом убрать страницу из Google, для этого используется noindex или ограничение доступа. Sitemap помогает сообщить Яндексу и другим поисковикам о структуре сайта, но не гарантирует индексацию.

Если сайт не индексируется, его страницы фактически не участвуют в поиске. Они могут быть опубликованы, красиво оформлены, заполнены текстами, добавлены в меню и даже отправлены в sitemap, но для поисковой системы их как будто нет. А если страницы не в поиске, они не получают органический трафик, не приводят пользователей и не помогают бизнесу.

Проблема может быть простой: сайт закрыт от индексации, стоит noindex, robots.txt запрещает обход, sitemap содержит не те URL, страницы отдают неправильный статус или canonical указывает на другой адрес. Но бывает сложнее: поисковик видит страницу, обходит её, но не добавляет в индекс из-за дублей, слабого качества, нехватки внутренней перелинковки, технических ошибок или низкой ценности контента.

Важно понимать разницу: поисковая система сначала должна найти URL, потом просканировать страницу, потом решить, стоит ли добавлять её в индекс. Google отдельно описывает crawling и indexing как процессы, связанные с тем, как поисковая система находит, обрабатывает и показывает контент в поиске. У Яндекса sitemap тоже используется как способ сообщить поисковому роботу о текущей структуре сайта.

Почему это важно

Индексация — это входной билет страницы в поиск. Если страницы нет в индексе, она не будет нормально ранжироваться по запросам. Можно улучшать текст, менять Title, ставить внутренние ссылки, покупать рекламу, писать статьи и радоваться красивым карточкам в WordPress, но органический поиск такую страницу всё равно не покажет.

Для владельца сайта проблема выглядит просто: «страницы не в поиске». Для SEO-специалиста это уже набор возможных причин: страница не найдена, запрещена к обходу, закрыта от индексации, имеет дубль, отдаёт ошибку, неправильно канонизирована, не попала в sitemap, не связана внутренними ссылками или не соответствует качеству, которое поисковик хочет хранить в индексе.

| Симптом | Что это может означать |

|---|---|

| Новая страница долго не появляется в поиске | поисковик ещё не нашёл или не проиндексировал URL |

| Страница есть в sitemap, но не в индексе | sitemap не гарантирует индексацию |

| Страница закрыта в Search Console или Вебмастере | есть технический запрет или проблема качества |

| В поиске отображается другой URL | canonical, дубль или выбранная поисковиком версия |

| В индексе только часть сайта | слабая структура, crawl budget, дубли, noindex, robots |

| Google индексирует, а Яндекс нет | разные правила обхода, качество, региональность, robots, sitemap |

| Яндекс индексирует, а Google нет | разные алгоритмы, технические сигналы, качество, canonical |

Сама по себе sitemap не является кнопкой «проиндексировать всё». Она помогает поисковикам узнать о страницах, но не заставляет их добавлять каждый URL в индекс. Поэтому при проблемах нужно проверять не только наличие sitemap, а всю цепочку: доступность страницы, статус-код, robots.txt, noindex, canonical, внутренние ссылки, качество контента и техническое состояние сайта.

Типовые причины

Первая причина — страница закрыта от индексации через noindex. В Google noindex может быть задан через meta-тег или HTTP-заголовок, и такая страница не должна появляться в результатах поиска. При этом Google подчёркивает важную деталь: чтобы робот увидел noindex, страница должна быть доступна для обхода, то есть не заблокирована robots.txt.

Вторая причина — robots.txt запрещает обход. Google описывает robots.txt как файл, который говорит поисковым роботам, какие URL они могут запрашивать; при этом robots.txt не является надёжным способом убрать страницу из результатов поиска, для этого нужен noindex или защита доступа. У Яндекса robots.txt тоже используется для управления параметрами индексирования и ограничения обхода страниц роботами.

Третья причина — неправильный canonical. Если canonical указывает на другую страницу, поисковик может считать текущий URL дублем и выбрать другой адрес для индекса. Это нормально для дублей, но плохо, если canonical настроен случайно или шаблонно.

Четвёртая причина — дубли страниц. Один и тот же контент может быть доступен по нескольким URL: со слэшем и без, с параметрами, через категории, теги, пагинацию, фильтры, UTM, http/https, www/без www. Google рекомендует указывать канонический URL для дублей, но финальный выбор canonical может оставаться за поисковой системой.

Пятая причина — страница возвращает неправильный статус. Например, 404, 403, 500, бесконечный редирект, цепочка редиректов или временный 302 вместо постоянного 301. Для пользователя это может быть незаметно, а для поискового робота это уже сигнал, что страницу нельзя нормально обработать.

Шестая причина — страница не связана с сайтом. URL есть, но на него почти нет внутренних ссылок. Такая страница может оказаться «сиротой»: она опубликована, но поисковому роботу сложно её найти через структуру сайта. Sitemap помогает, но внутренняя перелинковка всё равно важна.

Седьмая причина — слабое качество или низкая уникальная ценность страницы. Поисковик может обойти страницу, но не добавить её в индекс, если считает её дублем, тонким контентом, технической страницей, пустой карточкой, архивом без пользы или страницей, которая не даёт самостоятельной ценности.

| Причина | Где искать |

|---|---|

noindex | HTML-код, HTTP-заголовки, SEO-плагин, настройки CMS |

| robots.txt | файл /robots.txt, Яндекс Вебмастер, Search Console |

| Ошибка sitemap | sitemap.xml, отчёты поисковых систем |

| Неверный canonical | код страницы, SEO-плагин, шаблон |

| Дубли | параметры URL, теги, категории, фильтры |

| Ошибки статуса | 404, 403, 500, редиректы |

| Нет внутренних ссылок | меню, статьи, категории, карточки |

| Слабый контент | качество страницы, интент, структура |

| Медленная загрузка | скорость, сервер, изображения, скрипты |

| Новый сайт | поисковики ещё не накопили сигналов |

Как проверить

Проверять индексацию нужно по шагам. Не надо сразу менять robots.txt, sitemap, canonical и SEO-плагин одновременно. Так можно быстро превратить одну проблему в пять, зато с ощущением активной работы.

1. Проверить, есть ли страница в поиске

Начните с простого запроса:

site:example.com/page-url/

И отдельно проверьте домен:

site:example.com

Это не идеальный инструмент диагностики, но он быстро показывает, видит ли поисковик хотя бы часть сайта. Для точной проверки используйте Google Search Console и Яндекс Вебмастер.

| Что проверить | Где смотреть |

|---|---|

| Есть ли страница в Google | Google Search Console, оператор site |

| Есть ли страница в Яндексе | Яндекс Вебмастер, оператор site |

| Когда была последняя проверка | отчёты поисковых систем |

| Какой URL выбран основным | данные canonical и индексирования |

Для отдельной инструкции можно использовать материал как проверить индексацию сайта.

2. Проверить статус страницы

Страница должна отдавать корректный 200 OK, если она должна индексироваться. Если URL отдаёт 404, 403, 500, редирект или цепочку редиректов, индексация может не произойти.

| Статус | Что означает |

|---|---|

| 200 | страница доступна |

| 301 | постоянный редирект |

| 302 | временный редирект |

| 403 | доступ запрещён |

| 404 | страница не найдена |

| 500 | ошибка сервера |

| 503 | временная недоступность |

3. Проверить robots.txt

Откройте /robots.txt и посмотрите, не закрыты ли важные разделы. Особенно часто проблемы появляются после разработки, тестового режима, переноса сайта или неаккуратной настройки SEO-плагинов.

| Что искать | Почему важно |

|---|---|

Disallow: / | может закрыть весь сайт |

закрытие /wp-content/ | может мешать ресурсам |

| закрытие важных разделов | услуги и статьи могут не обходиться |

| разные правила для Googlebot и Yandex | поисковики могут видеть сайт по-разному |

| отсутствие sitemap-директивы | не критично, но лучше указать sitemap |

Подробно эту тему лучше раскрывать отдельно через статью robots.txt простыми словами.

4. Проверить noindex

Проверьте HTML-код страницы и HTTP-заголовки. Иногда noindex появляется из-за настроек SEO-плагина, шаблона, закрытого типа записи, тестового режима или случайной галочки в админке.

Где может быть noindex | Что проверить |

|---|---|

| meta robots | код страницы |

| X-Robots-Tag | HTTP-заголовки |

| SEO-плагин | настройки страницы и типа записей |

| WordPress | настройка «попросить поисковые системы не индексировать сайт» |

| шаблон | условный вывод meta-тегов |

5. Проверить sitemap

Sitemap должен содержать только актуальные канонические URL, которые действительно должны индексироваться. Яндекс указывает, что sitemap сообщает поисковику о текущей структуре сайта и может быть передан через robots.txt или интерфейс Яндекс Вебмастера.

| Что проверить в sitemap | Норма |

|---|---|

| Страница есть в sitemap | да, если она важна |

| URL отдаёт 200 | да |

| Нет noindex | да |

| Нет редиректа | желательно |

| Нет дублей | да |

| URL канонический | да |

| Sitemap отправлен в панели | желательно |

6. Проверить canonical

Если страница должна индексироваться сама, canonical должен указывать на неё же. Если canonical указывает на другую страницу, поисковик может не добавить текущий URL в индекс как самостоятельную страницу.

| Ситуация | Что делать |

|---|---|

| canonical на себя | нормально |

| canonical на другую страницу | проверить, действительно ли это дубль |

| canonical отсутствует | не всегда ошибка, но лучше контролировать |

| canonical ведёт на 404 | исправить |

| canonical ведёт на редирект | исправить на конечный URL |

7. Проверить качество страницы

Если технических запретов нет, но страница всё равно не индексируется, нужно смотреть содержание и ценность. Особенно это актуально для массовых страниц, тегов, фильтров, пустых категорий, похожих услуг, сгенерированных статей, дублей и слабых страниц без конкретики.

| Что оценить | Вопрос |

|---|---|

| Уникальность | страница не дублирует другие? |

| Интент | отвечает ли она запросу пользователя? |

| Полнота | достаточно ли информации? |

| Структура | есть ли H1, H2, логика блоков? |

| Внутренние ссылки | есть ли переходы на страницу и с неё? |

| Коммерческие элементы | есть ли CTA, контакты, доверие? |

| Техническая чистота | нет ли ошибок загрузки и рендера? |

Если проблема затрагивает много страниц, лучше не гадать по одной. В такой ситуации помогает SEO-аудит сайта: он позволяет проверить индексацию, структуру, семантику, технические ограничения, дубли и приоритеты исправлений.

Частые ошибки

Первая ошибка — думать, что добавление страницы в sitemap гарантирует индексацию. Sitemap помогает поисковику найти URL, но не заставляет его хранить страницу в индексе. Если страница закрыта, слабая, дублирующая или технически проблемная, sitemap её не спасёт.

Вторая ошибка — закрывать страницу в robots.txt и одновременно ставить noindex. Для Google это может работать не так, как ожидает владелец сайта: если робот не может обойти страницу из-за robots.txt, он может не увидеть noindex.

Третья ошибка — массово менять robots.txt без понимания. Одной строкой можно закрыть важный раздел, картинки, стили, скрипты или весь сайт. Потом сайт «почему-то» не индексируется. Конечно, почему-то. Просто роботу вежливо закрыли дверь и удивились, что он не зашёл.

Четвёртая ошибка — не проверять WordPress-настройки. В WordPress есть настройка видимости для поисковых систем. Плюс SEO-плагины могут ставить noindex для типов записей, архивов, тегов, категорий, медиа-страниц и отдельных материалов.

Пятая ошибка — путать отсутствие индексации с плохими позициями. Страница может быть в индексе, но ранжироваться низко. Это уже другая задача: контент, интент, конкуренты, ссылки, структура и качество страницы. Если страница не находится даже по site:, это один тип проблемы. Если она есть, но не в топе, другой.

Шестая ошибка — проверять только Google и забывать Яндекс, или наоборот. Для русскоязычных проектов часто важны обе системы. У них могут отличаться скорость обхода, реакция на robots.txt, качество страниц, региональность и выбранные версии URL.

| Ошибка | Что делать вместо этого |

|---|---|

| Полагаться только на sitemap | проверять всю цепочку индексации |

| Закрывать всё в robots.txt | закрывать только технически ненужное |

| Игнорировать noindex | проверять meta и HTTP-заголовки |

| Не смотреть canonical | проверять выбранную основную страницу |

| Путать индексацию и позиции | сначала понять, есть ли страница в индексе |

| Менять всё сразу | исправлять по шагам и фиксировать изменения |

| Не проверять Яндекс | смотреть обе поисковые системы |

Что исправлять в первую очередь

Если сайт не индексируется или часть страниц не в поиске, сначала нужно убрать технические запреты и ошибки. Потом уже улучшать контент, структуру и внутренние ссылки.

Блок приоритетов работ

| Приоритет | Что исправлять | Почему это важно |

|---|---|---|

| Критично | сайт закрыт от индексации целиком | поисковики не видят важные страницы |

| Критично | важные страницы с noindex | страницы не попадут в поиск |

| Критично | robots.txt закрывает нужные разделы | робот не может обойти URL |

| Критично | страницы отдают 404, 403, 500 | индексация невозможна или нестабильна |

| Высокий | canonical указывает не туда | поисковик выбирает другой URL |

| Высокий | sitemap содержит мусор или не содержит важные URL | робот получает неправильную карту сайта |

| Высокий | дубли и параметры создают хаос | поисковик не понимает основную версию |

| Средний | слабая внутренняя перелинковка | страницы труднее находить и оценивать |

| Средний | тонкий или дублирующий контент | поисковик может не добавить страницу |

| Низкий | мелкие SEO-предупреждения | исправлять после критичных проблем |

Если проблема массовая, например не индексируется весь сайт, услуги, статьи или новый раздел, лучше не ограничиваться одной правкой. Нужна связка: проверить robots.txt, noindex, sitemap, canonical, статусы, структуру, качество страниц и данные в панелях вебмастеров.

Если причина выглядит технической, есть смысл подключить технический аудит сайта. Он помогает найти проблемы с доступностью, статусами, редиректами, sitemap, robots.txt, скоростью, дублями, canonical и общей технической базой.

Мягкий переход к основной услуге здесь простой: когда страницы не в поиске, важно не просто «переотправить URL», а понять, почему поисковые системы их не берут. Для этого и нужен SEO-аудит: он показывает, где техническая проблема, где проблема структуры, а где страница просто не даёт поиску достаточной ценности.

Материал подготовлен Максимом Вагизовым для vagizov.com . При цитировании обязательна активная ссылка на источник.

Подробнее об авторских правах